Scala编程指南 大数据分析中的数据处理与存储支持服务

引言:Scala在大数据生态系统中的角色

Scala作为一门集面向对象与函数式编程范式于一身的语言,凭借其强大的表达力、类型安全性和与Java的无缝互操作性,已成为大数据分析领域的首选编程语言之一。特别是在Apache Spark等主流分布式计算框架中,Scala不仅是原生支持的语言,更因其简洁高效的特性,成为处理海量数据、构建复杂分析管道的利器。本指南旨在系统介绍如何利用Scala进行数据处理,并探讨其与各类存储服务的集成支持,以助力开发者构建稳健、高效的大数据应用。

第一部分:Scala核心特性助力数据处理

1. 函数式编程范式

Scala的函数式特性,如不可变性、高阶函数和模式匹配,为数据处理提供了天然优势。不可变数据结构确保了线程安全,便于并行处理;map、filter、reduce等高阶函数使数据转换链清晰可读;模式匹配则简化了复杂数据结构的解构与逻辑分支处理。

2. 强大的类型系统

Scala的静态类型系统和类型推断机制,能在编译期捕获许多错误,提升代码可靠性。结合case class和trait,可以优雅地定义数据模型,确保数据处理过程中的类型安全,减少运行时异常。

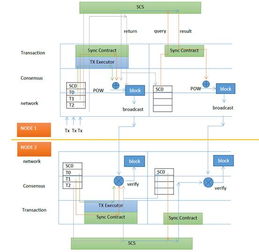

3. 并发与并行处理

通过Akka等actor模型库或原生Future/Promise,Scala支持高效的并发编程。在处理大规模数据时,能轻松实现异步任务和分布式计算,充分利用集群资源。

第二部分:数据处理实践:从ETL到分析

1. 数据摄取与清洗

使用Scala结合Apache Spark,可以方便地从CSV、JSON、Parquet等格式中读取数据。通过DataFrame API或Dataset API(强类型),进行缺失值处理、异常值过滤、格式标准化等清洗操作。例如:`scala

val df = spark.read.json("path/to/data.json")

val cleaned = df.filter("age > 0").na.fill(Map("name" -> "Unknown"))`

2. 转换与聚合

利用Spark的转换操作(如select、groupBy、join)和聚合函数(如sum、avg),实现数据重塑与汇总。Scala的链式调用使代码流畅:`scala

val aggregated = cleaned.groupBy("department").agg(avg("salary").alias("avg_salary"))`

3. 机器学习与高级分析

通过MLlib库,Scala支持常见的机器学习算法(如分类、聚类、推荐)。可以构建管道(Pipeline)将特征工程、模型训练和评估串联起来,实现端到端的分析流程。

第三部分:存储支持服务集成

1. 分布式文件系统:HDFS

Scala通过Hadoop API或Spark的封装,可直接读写HDFS上的数据。这为持久化原始数据、中间结果和最终输出提供了可靠存储。

2. 数据湖与云存储

与Amazon S3、Azure Blob Storage、Google Cloud Storage等云存储服务的集成,可通过相应SDK或Spark配置轻松实现。Scala程序能跨云环境处理数据,支持混合架构。

3. 数据库与数据仓库

- NoSQL数据库:如Cassandra、MongoDB,通过官方Scala驱动或Spark连接器,支持高效读写。

- 关系型数据库:使用JDBC或特定库(如Slick),进行OLTP操作或批量数据迁移。

- 数据仓库:如Snowflake、Redshift,利用Spark连接器执行复杂查询和数据加载。

4. 消息队列与流存储

对于实时数据处理,Scala可与Kafka、Pulsar等消息系统集成,通过消费者/生产者API实现流式摄取。结合Spark Streaming或Akka Streams,构建低延迟的数据管道。

第四部分:最佳实践与优化建议

- 代码组织:采用模块化设计,将数据逻辑、业务规则和存储访问分离,提升可维护性。

- 性能调优:合理缓存(

persist)、分区数据、避免shuffle,以优化Spark作业。使用foreachPartition进行批量存储操作,减少连接开销。 - 错误处理:利用Scala的

Try、Either等类型优雅处理异常,确保管道容错性。 - 测试:借助ScalaTest或Specs2,对数据处理逻辑进行单元和集成测试,模拟存储交互。

- 监控与日志:集成SLF4J记录关键指标,结合Prometheus等工具监控作业健康度。

###

Scala以其独特的语言特性和丰富的生态系统,为大数据分析提供了从数据处理到存储集成的全方位支持。通过掌握核心编程技巧,并结合Spark等框架及各类存储服务,开发者能够构建出高效、可扩展的数据应用。随着数据规模的持续增长,深入理解Scala在大数据场景下的应用,将成为数据工程师和科学家的重要竞争力。

---

注:本指南基于Scala 2.x及Apache Spark 3.x版本,实际应用中请参考最新官方文档。

如若转载,请注明出处:http://www.zhaocebao.com/product/52.html

更新时间:2026-05-30 01:14:03